2026년 1월, Alibaba의 Qwen 팀이 음성 합성 기술의 새로운 이정표를 세우는 Qwen3-TTS를 Apache 2.0 라이선스로 공개했습니다. 최근 GPT-4o와 같은 멀티모달 모델들이 주목받고 있지만, 고품질 음성 생성 기술은 대부분 폐쇄적인 상용 API로만 제공되어 왔습니다. Qwen3-TTS는 이러한 한계를 돌파하며, 모델 가중치는 물론 핵심 기술인 음성 토크나이저, 학습 코드, 그리고 상세한 기술 보고서까지 완전히 공개했습니다.

Qwen3-TTS의 핵심 특징

1. 압도적인 학습 데이터와 다국어 지원

Qwen3-TTS는 500만 시간 이상의 방대한 다국어 음성 데이터로 학습되었습니다. 한국어를 포함하여 중국어, 영어, 일본어, 독일어, 프랑스어, 러시아어, 포르투갈어, 스페인어, 이탈리아어 등 10개 언어를 지원하며, 각 언어에서 자연스러운 발화가 가능합니다.

2. 혁신적인 이중 토크나이저 전략

Qwen3-TTS의 가장 큰 기술적 특징은 용도에 따라 선택할 수 있는 두 가지 토크나이저입니다:

12Hz Tokenizer – 초저지연 실시간 스트리밍

- 초당 12.5회의 낮은 샘플링 빈도로 극도의 압축 달성

- 16개 레이어의 다중 코드북(Multi-codebook) 구조

- 완전한 인과적(Causal) 설계로 97ms의 극저지연 구현

- 첫 번째 오디오 패킷을 즉시 출력하여 실시간 대화에 최적

25Hz Tokenizer – 최고 음질 추구

- 초당 25회 샘플링으로 더욱 풍부한 음향 정보 보존

- Flow Matching 기반 DiT(Diffusion Transformer) 디코더 사용

- 영화 더빙, 오디오북 등 최상의 음질이 필요한 작업에 적합

- PESQ 3.21, UTMOS 4.16의 업계 최고 수준 음질 지표

3. 다양한 모델 라인업

Qwen3-TTS는 사용 목적에 따라 세 가지 변형 모델을 제공합니다:

| 모델 | 주요 기능 | 특징 |

|---|---|---|

| Base (0.6B/1.7B) | 음성 복제 | 3초 분량의 참조 오디오로 빠른 음성 복제, 파인튜닝용 기본 모델 |

| VoiceDesign (1.7B) | 음성 디자인 | 텍스트 설명만으로 완전히 새로운 목소리 생성 |

| CustomVoice (0.6B/1.7B) | 프리미엄 음색 | 9가지 프리미엄 음색 내장, 지시사항 기반 스타일 제어 |

4. 뛰어난 성능 지표

제로샷 음성 생성 (Seed-TTS 벤치마크)

- 영어: WER 1.24 (업계 1위)

- 중국어: WER 0.77 (최상위권)

교차 언어 성능

- 중국어→한국어: WER 4.82 (CosyVoice3 대비 66% 개선)

- 10개 언어 간 자연스러운 교차 변환

음질 복원력

- 12Hz 토크나이저: PESQ 3.21, UTMOS 4.16

- 기존 SOTA 코덱(SpeechTokenizer, Mimi) 능가

주요 기능

제로샷 음성 복제 (Zero-Shot Voice Cloning)

단 3초 분량의 참조 오디오만으로 훈련에 없던 목소리도 즉시 복제할 수 있습니다. 단순히 음색만 흉내 내는 것이 아니라, 참조 오디오에 담긴 운율과 감정까지 파악하여 반영합니다.

wavs, sr = model.generate_voice_clone(

text="안녕하세요, 복제된 목소리로 말하고 있습니다.",

language="Korean",

ref_audio="reference.wav",

ref_text="참조 오디오의 전사 텍스트"

)

음성 디자인 (Voice Design)

텍스트 프롬프트만으로 세상에 없는 목소리를 창조할 수 있습니다:

wavs, sr = model.generate_voice_design(

text="안녕하세요, 새롭게 디자인된 목소리입니다.",

language="Korean",

instruct="차분하고 신뢰감 있는 중저음의 남성 뉴스 앵커 목소리"

)

프리미엄 음색 제어

CustomVoice 모델은 9가지 프리미엄 음색을 제공하며, 각 화자의 고유한 특성을 유지합니다:

| 화자 | 특성 | 모국어 |

|---|---|---|

| Vivian | 밝고 활기찬 젊은 여성 | 중국어 |

| Serena | 따뜻하고 부드러운 여성 | 중국어 |

| Uncle_Fu | 성숙한 저음의 남성 | 중국어 |

| Dylan | 베이징 방언의 청년 | 중국어(베이징) |

| Eric | 청두 방언의 활기찬 남성 | 중국어(쓰촨) |

| Ryan | 역동적인 남성 | 영어 |

| Aiden | 밝은 미국 남성 | 영어 |

| Ono_Anna | 경쾌한 일본 여성 | 일본어 |

| Sohee | 따뜻한 한국 여성 | 한국어 |

기술적 혁신

Dual-Track LM 아키텍처

Qwen3-TTS는 텍스트 토큰과 음성 토큰을 시퀀스 길이가 아닌 채널 축(Channel axis)을 따라 연결하여 처리합니다. 이를 통해 텍스트 입력 즉시 대응하는 음성 토큰을 지체 없이 예측할 수 있어 동시성 처리가 가능해졌습니다.

MTP (Multi-Token Prediction)

12Hz 모델은 다중 코드북을 효율적으로 처리하기 위해 MTP 모듈을 활용합니다:

- 백본 모델이 0번째 코드북(기본 정보) 예측

- MTP 모듈이 나머지 1~15번 레이어(음향 디테일) 동시 예측

- 단일 프레임 내에서 모든 계층의 토큰을 즉시 생성

체계적인 3단계 학습

사전 학습 (Pre-training)

- 일반 단계: 500만 시간의 다국어 데이터로 기본 매핑 학습

- 고품질 단계: 선별된 데이터로 지속 학습하여 환각 현상 억제

- 장문 맥락 단계: 최대 32,768 토큰까지 처리하여 긴 문장 생성 능력 확보

사후 학습 (Post-training)

- DPO (Direct Preference Optimization)로 인간 선호도 반영

- 화자 파인튜닝으로 표현력과 제어 가능성 완성

설치 및 사용

환경 요구사항

권장 사양

- GPU: NVIDIA GPU (VRAM 16GB 이상 권장)

- 0.6B 모델: RTX 3090, RTX 4090, A10, V100 이상

- 1.7B 모델: A100 (40GB), H100 권장

- RAM: 32GB 이상

- 저장공간:

- 0.6B 모델: 약 3GB

- 1.7B 모델: 약 7GB

- 토크나이저: 약 1GB

- CUDA: 11.8 이상

- Python: 3.12 권장

최소 사양

- GPU VRAM:

- 0.6B 모델: 8GB (INT8 양자화 시)

- 1.7B 모델: 12GB (INT8 양자화 시)

- RAM: 16GB

- FlashAttention 2 사용 시 메모리 사용량 대폭 감소

성능 참고

- RTX 4090 (24GB): 1.7B 모델 실시간 스트리밍 가능

- RTX 3090 (24GB): 0.6B/1.7B 모델 모두 실행 가능

- T4 (16GB): 0.6B 모델 실행 가능, 1.7B 모델은 양자화 필요

- A100 (40GB/80GB): 모든 모델 최적 성능

설치 방법

# 1. 가상환경 생성 (권장)

conda create -n qwen3-tts python=3.12 -y

conda activate qwen3-tts

# 2. qwen-tts 패키지 설치

pip install -U qwen-tts

# 3. FlashAttention 2 설치 (선택사항, GPU 메모리 절약)

pip install -U flash-attn --no-build-isolation

# RAM이 96GB 미만이고 CPU 코어가 많은 경우

MAX_JOBS=4 pip install -U flash-attn --no-build-isolation

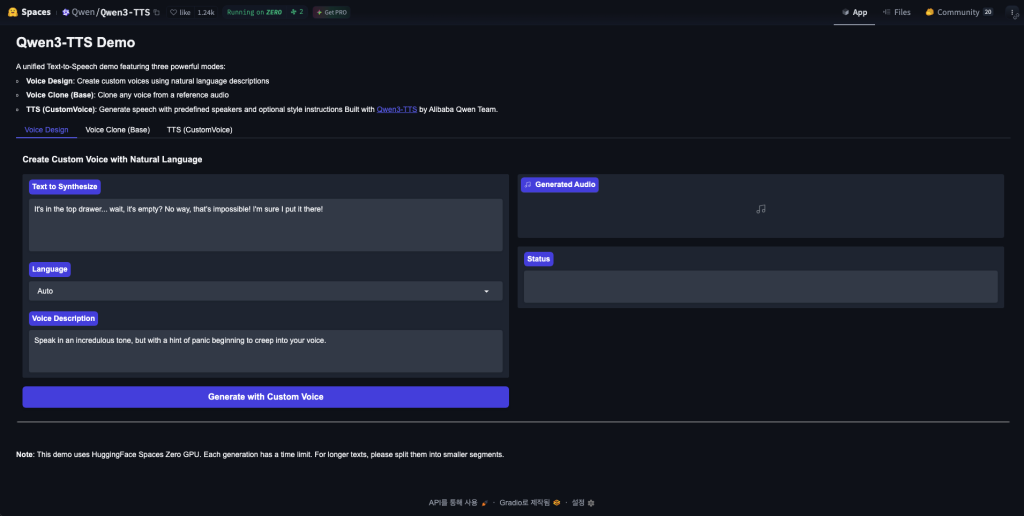

데모 사용

데모는 아래 두곳에서 사용해볼 수 있습니다. 실제 결과물은 매우 놀랍습니다.

기본 사용 예시

1. 음성 디자인

import torch

import soundfile as sf

from qwen_tts import Qwen3TTSModel

model = Qwen3TTSModel.from_pretrained(

"Qwen/Qwen3-TTS-12Hz-1.7B-VoiceDesign",

device_map="cuda:0",

dtype=torch.bfloat16,

attn_implementation="flash_attention_2",

)

wavs, sr = model.generate_voice_design(

text="안녕하세요, 저는 텍스트 설명만으로 만들어진 목소리입니다.",

language="Korean",

instruct="차분하고 신뢰감 있는 중저음의 남성 뉴스 앵커 목소리"

)

sf.write("output.wav", wavs[0], sr)

2. 커스텀 음색 사용

model = Qwen3TTSModel.from_pretrained(

"Qwen/Qwen3-TTS-12Hz-1.7B-CustomVoice",

device_map="cuda:0",

dtype=torch.bfloat16,

attn_implementation="flash_attention_2",

)

wavs, sr = model.generate_custom_voice(

text="안녕하세요, 반갑습니다!",

language="Korean",

speaker="Sohee",

instruct="매우 기쁜 목소리로"

)

sf.write("output.wav", wavs[0], sr)

3. 음성 복제

model = Qwen3TTSModel.from_pretrained(

"Qwen/Qwen3-TTS-12Hz-1.7B-Base",

device_map="cuda:0",

dtype=torch.bfloat16,

attn_implementation="flash_attention_2",

)

wavs, sr = model.generate_voice_clone(

text="이것은 복제된 목소리로 생성된 음성입니다.",

language="Korean",

ref_audio="reference.wav",

ref_text="참조 오디오의 정확한 전사 텍스트"

)

sf.write("output.wav", wavs[0], sr)

Web UI 데모 실행

# CustomVoice 모델

qwen-tts-demo Qwen/Qwen3-TTS-12Hz-1.7B-CustomVoice --ip 0.0.0.0 --port 8000

# VoiceDesign 모델

qwen-tts-demo Qwen/Qwen3-TTS-12Hz-1.7B-VoiceDesign --ip 0.0.0.0 --port 8000

# Base 모델 (HTTPS 권장)

qwen-tts-demo Qwen/Qwen3-TTS-12Hz-1.7B-Base \

--ip 0.0.0.0 --port 8000 \

--ssl-certfile cert.pem \

--ssl-keyfile key.pem

vLLM을 통한 배포

vLLM은 Qwen3-TTS를 day-0부터 공식 지원합니다. vLLM-Omni를 사용하면 고성능 추론이 가능합니다:

# vLLM-Omni 저장소 복제 git clone https://github.com/vllm-project/vllm-omni.git cd vllm-omni/examples/offline_inference/qwen3_tts # CustomVoice 태스크 실행 python end2end.py --query-type CustomVoice # VoiceDesign 태스크 실행 python end2end.py --query-type VoiceDesign # Base 모델 음성 복제 python end2end.py --query-type Base --mode-tag icl

파인튜닝

특정 도메인이나 화자에 맞춰 모델을 최적화할 수 있습니다. 상세한 파인튜닝 가이드는 GitHub 저장소의 finetuning 디렉토리에서 확인할 수 있습니다.

실무 활용 사례

1. 실시간 대화 시스템

- 97ms의 초저지연으로 자연스러운 음성 비서 구현

- 다국어 지원으로 글로벌 서비스 제공

2. 콘텐츠 제작

- 영화 더빙, 오디오북, 팟캐스트 자동 생성

- 텍스트 설명만으로 캐릭터 보이스 디자인

3. 접근성 향상

- 시각장애인을 위한 고품질 TTS

- 다국어 음성 번역 서비스

4. 교육 및 엔터테인먼트

- 개인화된 음성 튜터

- 게임 캐릭터 음성 생성

마치며

Qwen3-TTS는 단순한 TTS 모델을 넘어, 음성 AI의 실사용의 수준을 높은 품질로 사용할수 있도록 끌어올렸다고 생각합니다. Apache 2.0 라이선스로 완전히 공개되어 누구나 자유롭게 연구하고 상업적으로 활용할 수 있습니다. 500만 시간의 학습 데이터, 혁신적인 이중 토크나이저 전략, 그리고 업계 최고 수준의 성능 지표는 Qwen3-TTS가 음성 합성 분야에 놀라운 성과를 이뤘다고 단언할수 있겠습니다.

참고 자료

- 기술 논문: Qwen3-TTS Technical Report

- 공식 블로그: Qwen Blog

- GitHub: QwenLM/Qwen3-TTS

- Hugging Face: Qwen3-TTS Collection

- DashScope API: API Documentation

답글 남기기