Model Context Protocol(MCP)은 대규모 언어 모델(LLM)에 외부 정보를 제공하는 새로운 방법으로, 기존 RAG(Retrieval-Augmented Generation)의 한계를 넘어서는 차세대 접근법입니다. 이 글에서는 MCP의 개념, 사용 사례, RAG와의 차이점, 그리고 더 많은 정보를 얻을 수 있는 자료를 소개합니다.

MCP란 무엇인가?

Model Context Protocol은 LLM이 외부 소스와 상호작용하여 필요한 정보를 실시간으로 가져오는 표준화된 방법입니다. 기존 RAG가 미리 검색된 정보를 프롬프트에 삽입하는 방식이라면, MCP는 LLM이 스스로 필요한 정보를 요청하고 검색할 수 있는 양방향 통신 프로토콜을 제공합니다.

MCP의 핵심 아이디어는 다음과 같습니다:

- 자기 인식 요청: LLM이 자신에게 필요한 정보가 무엇인지 인식하고 명확한 요청을 형성

- 동적 컨텍스트 확장: 대화 중 필요에 따라 실시간으로 외부 정보 접근

- 구조화된 통신: LLM과 외부 도구 간의 표준화된 인터페이스

RAG와 MCP의 주요 차이점

| 특성 | RAG | MCP |

|---|---|---|

| 정보 흐름 | 일방향(사전에 검색된 정보를 프롬프트에 삽입) | 양방향(LLM이 필요한 정보를 요청하고 받음) |

| 검색 시점 | 사용자 쿼리 시점에 고정 | 대화 중 동적으로 필요할 때 |

| 맥락 제어 | 시스템 또는 개발자가 제어 | LLM이 더 많은 자율성을 가짐 |

| 맥락 창 활용 | 검색된 모든 정보가 맥락 창을 차지 | 필요한 정보만 선택적으로 요청하여 효율적 |

| 구현 복잡성 | 상대적으로 단순 | 양방향 통신 프로토콜 구현 필요 |

MCP 사용 예시

- 고급 지식 기반 응답 생성

- 최신 연구 논문에 기반한 과학적 질문 답변

- 실시간 데이터베이스에 접근하여 최신 기업 데이터 분석

- 복잡한 추론이 필요한 작업

- 여러 소스의 정보를 종합해야 하는 법률 문서 분석

- 다단계 수학 문제 해결 중 필요한 공식이나 이론 참조

- 개인화된 사용자 경험

- 사용자 데이터에 접근하여 맞춤형 추천 제공

- 개인 지식 베이스와 연결하여 프로젝트 관리 도우미 구현

- 다중 도구 조정

- 코드 실행, 웹 검색, 데이터베이스 쿼리 등 여러 도구 통합

- 복잡한 워크플로우 자동화

MCP 사용 사례: 실제 연동 가능한 서비스 예시

Model Context Protocol(MCP) 개념은 실제로 여러 서비스와 통합되어 활용되고 있습니다.

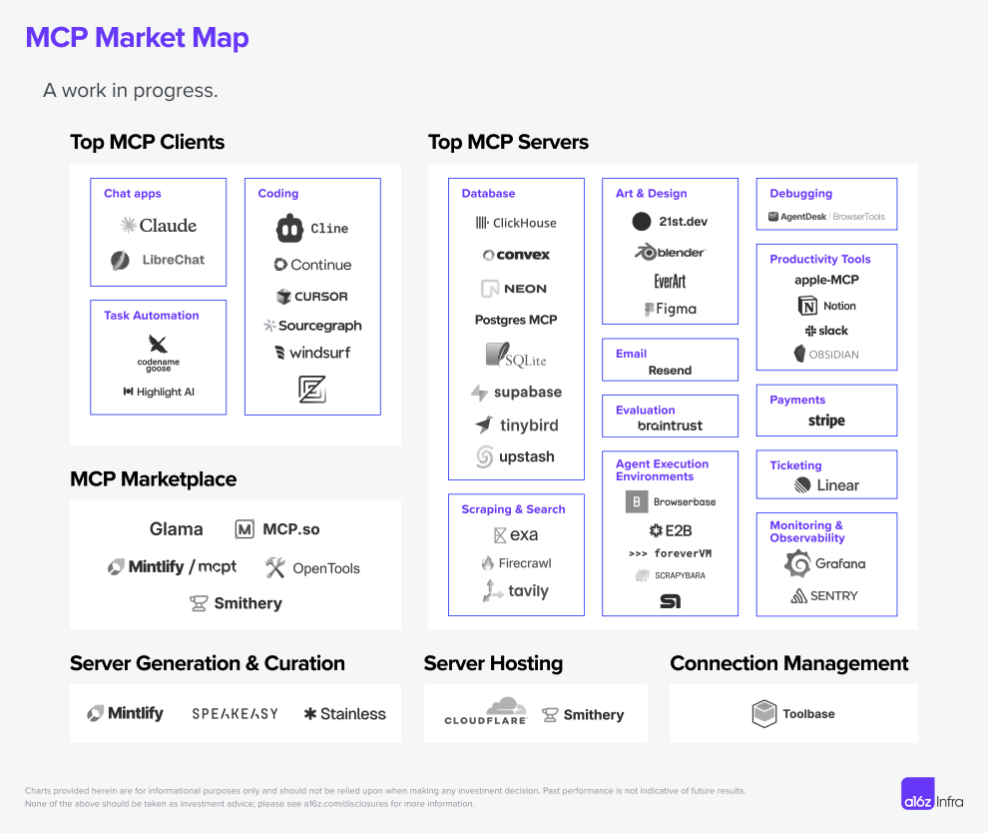

기본적으로 MCP는 Client 군 과 Server군으로 나뉘어 볼수 있습니다. Client는 우리가 이미 익숙한 LLM 서비스 (ChatGPT, Claude, LibreChat, Sursor …) 들이라고 보면 됩니다. Server 군은 Context를 제공해줄 레파지토리, 데이터베이스, 디자인도구, email, Search, Scraping 등 소스를 제공해줄수 있는 대상이 됩니다. 크게 이 둘을 이어주기 위한 표준화된 프로토콜이 나타났다고 보고, 이를 원활하게 이어줄 수 있는 마켓 플레이스 들이 등장하고 있는 추세 입니다.

오픈소스로 MCP서버에 대한 정보를 제공하는 마켓 플레이스도 점점 등장하고 있습니다. https://smithery.ai/, https://pulsemcp.com 등 대표적인 마켓 플레이스 입니다.

다음은 MCP 원리를 적용하여 실제로 연동 가능한 서비스 사례들입니다:

1. Anthropic Claude와 검색엔진 연동

Anthropic의 Claude AI는 http api 기능을 통해 실시간으로 검색엔진 검색을 수행할 수 있습니다.

실제 구현 사례 : Claude와 Brave Search Engine: Model Context Protocol(MCP)의 실제 적용 사례

- 실제 사용 예: 사용자가 최신 뉴스나 실시간 정보를 요청하면, Claude는 api 기능을 활용해 정보를 검색하고 요약하여 제공

- 작동 방식: Claude가 정보 부족을 감지하면 스스로 웹 검색을 요청하고, 관련 정보를 찾아 맥락에 통합

2. Anthropic Claude와 로컬 파일 및 디렉토리 연동

문맥중에 내 로컬의 파일에 대한 조회가 요구될때, 직접 파일에 엑세스 하여 파일에 대한 정보를 참조할수 있습니다.

실제 구현사례 : Claude 와 Filesystem : Model Context Protocol(MCP) 실제 적용 사례

3. Anthropic Claude와 구글 드라이브 연동

구글 인증을 통해서 구글 드라이브 안에 파일에 대한 엑세스 권한을 가지고 파일에 대한 정보를 이용한 AI 사용이 가능합니다.

실제 구현사례 : Google Drive MCP 서버: Claude와 Google Drive를 연결하는 강력한 도구

이러한 실제 서비스 연동 사례들은 MCP의 강력한 잠재력을 보여주며, LLM이 자신의 한계를 넘어 외부 도구와 데이터 소스를 활용하여 더 정확하고 유용한 응답을 생성할 수 있게 해줍니다.

MCP 적용 시 고려사항

- 성능 오버헤드

- 실시간 정보 검색 및 처리로 인한 지연 시간

- 서버 부하 관리 전략

- 보안 및 개인정보

- 외부 소스 접근 권한 관리

- 민감한 정보 처리 방법

- 신뢰성 및 일관성

- 다양한 소스에서 얻은 정보의 품질 검증

- 모순된 정보 처리 메커니즘

더 알아보기

커뮤니티 및 자료

- 연구 논문

- “LLM Self-Reflection and Context Management” (AI Research Labs, 2024)

- “Dynamic Context Expansion for Large Language Models” (Stanford NLP Group)

- 개발자 커뮤니티

- HuggingFace 포럼: Model Context Protocol 섹션

- GitHub: ModelContextProtocol 오픈소스 구현체

- Discord: LLM Tools & Protocols 채널

- 기술 블로그

- Anthropic의 Claude 기술 블로그

- OpenAI 개발자 포럼

- LangChain 문서 및 튜토리얼

시작하기 위한 자료

- PulseMCP : https://www.pulsemcp.com/

- GitHub 레포지토리: github.com/model-context-protocol/starter

- 튜토리얼: modelcontextprotocol.org/learn

- 개발자 문서: docs.modelcontextprotocol.org

결론

Model Context Protocol은 LLM의 능력을 크게 확장하는 유망한 새로운 패러다임입니다. RAG의 한계를 넘어 더 동적이고 자율적인 정보 검색 메커니즘을 제공함으로써, 더 정확하고 맥락에 맞는 응답 생성이 가능해집니다. MCP는 아직 발전 초기 단계에 있지만, AI 시스템이 더 복잡한 작업을 수행하고 실시간 정보에 접근해야 하는 필요성이 증가함에 따라 앞으로 더욱 중요해질 것입니다.

MCP 생태계는 빠르게 성장하고 있으며, 개발자와 연구자들이 함께 이 새로운 프로토콜을 발전시키고 있습니다. 이 분야에 관심이 있다면 위에 언급된 커뮤니티에 참여하여 최신 발전 상황을 따라가는 것이 좋겠습니다.

답글 남기기