-

자율적인 AI 코딩 루프 실행에 대한 종합 가이드: Ralph Playbook 방법론

Geoffrey Huntley가 고안하고 Clayton Farr가 체계화한 Ralph Playbook은 AI를 활용한 자율적 코딩의 새로운 패러다임을 제시합니다. 이 방법론의 핵심은 간단합니다. Claude와 같은 LLM을 반복적인 루프 안에서 실행시키면서, 각 반복마다 깨끗한 컨텍스트로 시작하여 하나의 작업만 수행하도록 하는 것입니다. 흥미로운 점은 이름의 유래입니다. “Ralph Wiggum”은 심슨 가족에 나오는 순수하지만 다소 어리석은 캐릭터로, 복잡한 지시사항을 따르기보다는 단순하고 반복적인 작업에서…

-

AI Agent를 위한 장기 메모리 솔루션: Mem0 완벽 가이드

요즘 AI Agent 서비스에 있어서 가장 중요한 초개인화 AI 서비스에 대해서 Long Term Memory의 요구사항이 증가하고 있어서 이를 대비한 다양한 오픈소스 코드와 서비스에 대해서 알아보고 있는 중입니다. 지난번 언급했던 Supermemory와 마찬가지로 또 새로운 서비스+오픈소스가 있어서 소개하고려고 합니다. 바로 Mem0입니다. Mem0는 AI 애플리케이션에 지능형 메모리 레이어를 추가하여 개인화된 AI 경험을 가능하게 하는 오픈소스 솔루션이자 관리형 서비스입니다.…

-

Supermemory: LLM을 위한 Universal Memory Layer

AI 시대에 가장 큰 과제 중 하나는 바로 ‘기억(Memory)’입니다. 대부분의 LLM은 대화가 끝나면 모든 컨텍스트를 잊어버리고, 다음 세션에서는 마치 처음 만난 사람처럼 행동합니다. 이러한 문제를 해결하기 위해 등장한 것이 바로 Supermemory입니다. Supermemory란? Supermemory는 19세 창업자 Dhravya Shah가 개발한 AI 애플리케이션을 위한 범용 메모리 레이어입니다. 2025년 10월 Google AI 총괄 Jeff Dean, Cloudflare CTO Dane Knecht,…

-

AI에게 기억을 준다는 것

AI에게 장기 메모리(Long-Term Memory)가 생긴다는 것은 단순한 ‘기능 추가’를 넘어, AI가 ‘단발성 도구’에서 ‘지속적인 파트너’로 진화한다는 것을 의미합니다. 현재 대부분의 LLM(대규모 언어 모델)은 대화창을 닫거나 일정 분량(컨텍스트 윈도우)이 넘어가면 이전 내용을 잊어버리는 ‘휘발성’을 가지고 있습니다. 장기 메모리는 이 한계를 극복하는 핵심 열쇠입니다. 모델은 과거의 상호작용, 사용자의 선호, 행동 패턴 등을 저장하고, 이를 기반으로 새로운 환경이나,…

-

AGENTS.md: AI 시대의 프로젝트 문서화 혁신

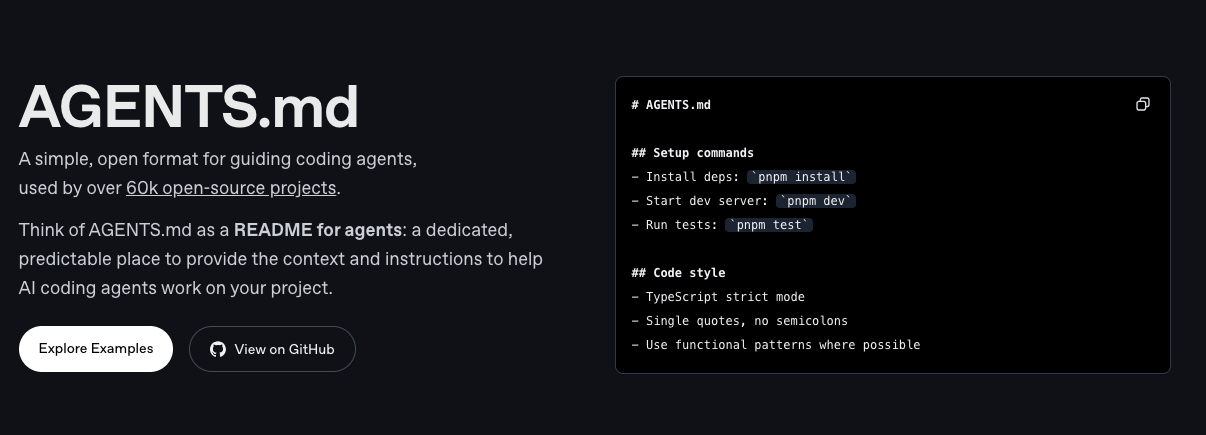

들어가며 AI와 함께 코딩하는 시대가 본격적으로 도래했습니다. GitHub Copilot, Cursor, Claude Code 등 다양한 AI 코딩 어시스턴트들이 개발자의 일상에 깊숙이 자리 잡으면서, 우리는 “바이브 코딩(Vibe Coding)”이라는 새로운 개발 패러다임을 경험하고 있습니다. 하지만 AI 에이전트가 우리의 프로젝트를 제대로 이해하고 효과적으로 기여하려면 무엇이 필요할까요? 바로 이 지점에서 AGENTS.md가 등장합니다. OpenAI, Google, Factory.ai, Cursor 등이 협력하여 만든 이…

-

Antigravity: AI 에이전트 시대를 여는 새로운 개발 플랫폼

들어가며 2025년 11월 18일, Google DeepMind는 Gemini 3 모델 출시와 함께 개발자들을 위한 혁신적인 도구를 공개했습니다. 바로 Google Antigravity입니다. “반중력”이라는 이름처럼, 이 도구는 무거운 코딩 작업의 중력에서 개발자를 해방시키겠다는 야심찬 목표를 가지고 있습니다. Antigravity는 단순한 AI 코딩 어시스턴트가 아닙니다. 에이전트가 계획을 수립하고, 실행하고, 에디터, 터미널, 브라우저를 통해 복잡한 작업을 검증할 수 있도록 하는 “에이전트 우선(Agent-first)”…

-

AI 애플리케이션 개발을 위한 추천 플랫폼, Dify AI Platform

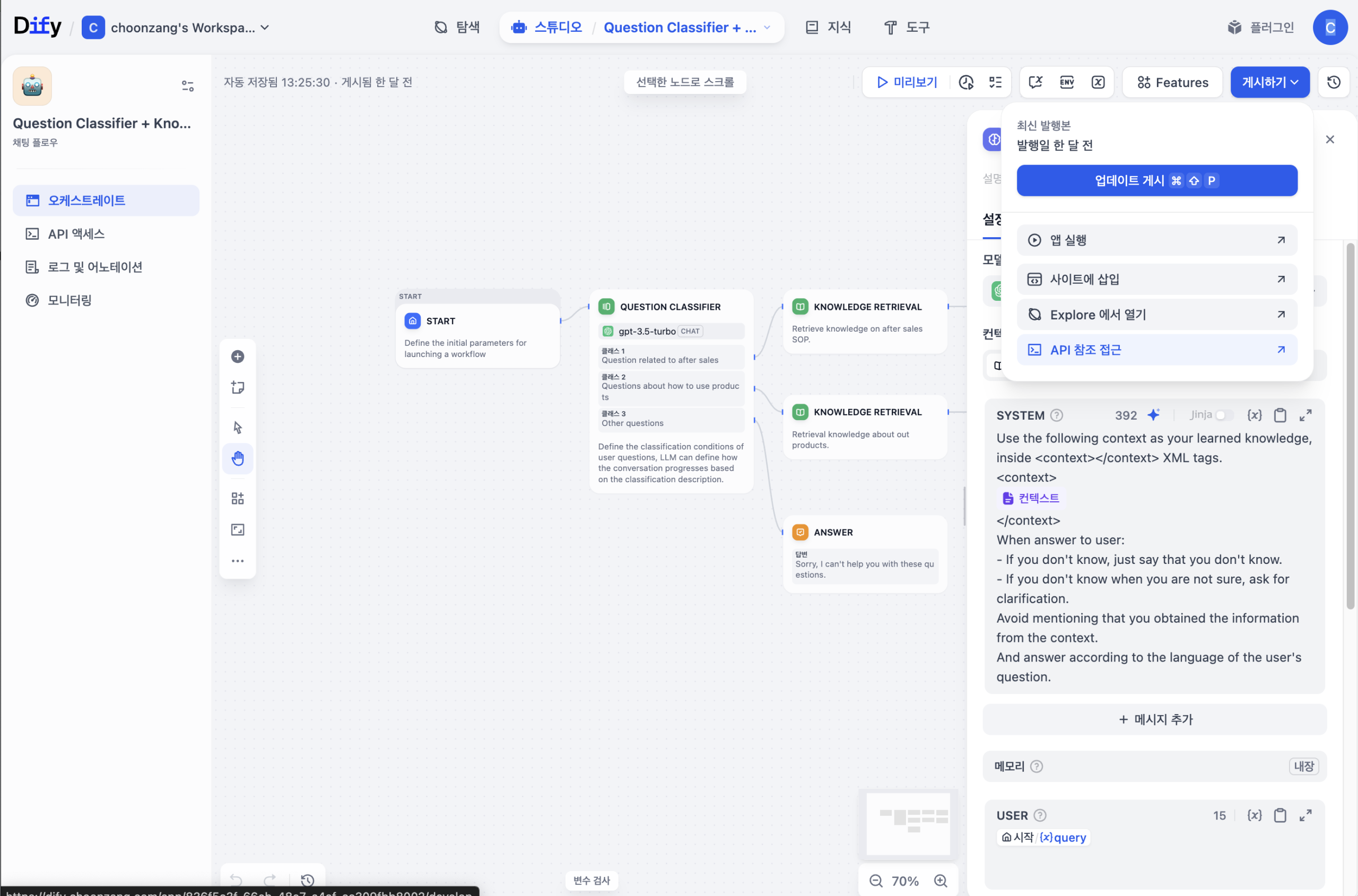

Dify란? 앞서 다양한 Agent를 사용한 Workflow도구들이 많이 소개했었는데요. 이번에 매우 직관적이고, 간단하게 AI 어플리케이션 개발에 필요한 백엔드 도구가 있어서 소개하려고 합니다. 바로 Dify 인데요. Dify는 프로덕션 수준의 AI 에이전트 워크플로우를 구축하기 위한 오픈소스 플랫폼입니다. 이름 Dify는 “Do It For You”의 약자로, 복잡한 AI 애플리케이션 개발 과정을 단순화하고 자동화하겠다는 플랫폼의 철학을 담고 있습니다. 공식출시는 2023년 5월9일입니다.…

-

셔터 아일랜드: 마틴 스코세이지의 심리 스릴러 걸작

반전 영화라고 한다면, 흔히 식스센스를 꼽습니다. 그만큼의 데미지?가 있을 만한 반전 영화로 꼽을 만한 것이 바로 이 셔터아일랜드 입니다. 개봉한지 15년이 지난 이 영화를 리뷰글로 올리게 된 것은 요즘 복잡한 심정에서 잠시 해방되고자 몰입도 높고, 유심히 봐야 하는 영화를 고르다보니 이 영화를 선택하게 되었네요. 마틴 스코세이지 감독의 ‘셔터 아일랜드’는 관객들에게 끝까지 진실을 숨기고 마지막에 모든…

-

퇴근하는데 4시간…

올해 내린 첫눈은 공교롭게 퇴근 시간에 맞물렸고 나의 귀가 길은 경이로운 4시간의 기록을 남겼다. 새로운 동네 구경도 하고, 아이스링크에서 스핀도 경험하고, 갈까말까 망설이기도 하면서 심심할 겨를이 없다.