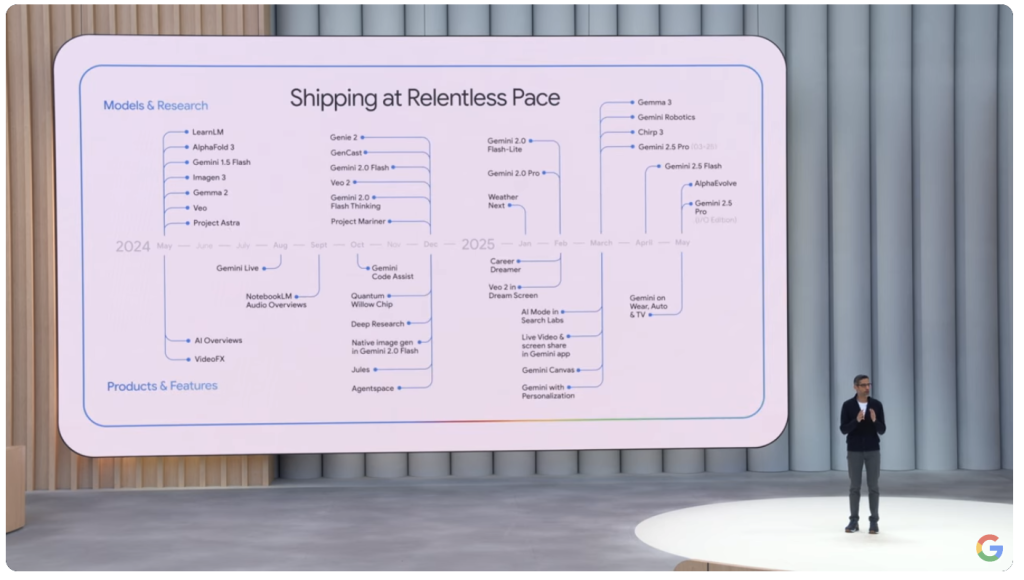

구글이 최근 개최한 연례 개발자 컨퍼런스 ‘구글 I/O 2025’에서는 구글의 다양한 플랫폼과 Google DeepMind의 최신 AI 모델을 활용한 혁신적인 기술들이 대거 공개되었습니다. 이번 행사에서는 특히 Gemini를 중심으로 한 AI 기술의 발전과 개발자 경험 향상에 초점을 맞추었습니다.

1. Gemini 2.5와 AI 혁신

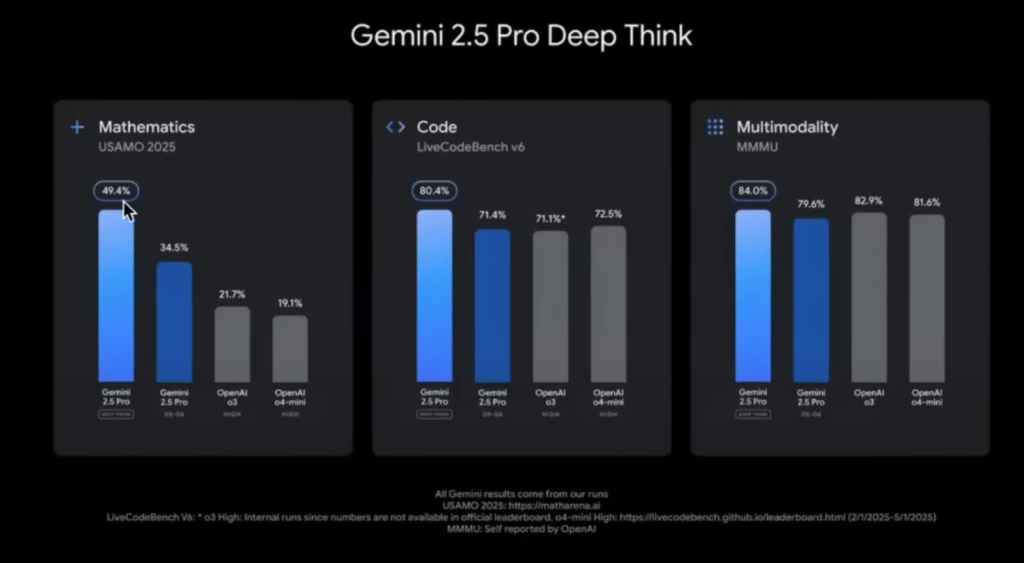

- 구글은 최신 AI 모델인 Gemini 2.5 Pro와 Flash를 공개했습니다. 특히 Pro 모델은 ‘딥씽크(Deep Think)’ 모드를 통해 복잡한 수학, 프로그래밍 등 고차원적 문제 해결 능력이 크게 강화되었습니다. 이 모드는 여러 가설을 동시에 탐색하며, 답변의 깊이와 정확성을 높입니다. 이 딥씽크는 SOTA를 뛰어넘는 성능을 자랑한다고 말합니다. ( *SOTA는 ‘State of the Art’의 약어로, 인공지능(AI) 및 기계 학습(ML) 분야에서 특정 작업에 대해 현재 사용 가능한 최고의 모델 또는 알고리듬을 의미)

- Gemini 2.5 Flash는 하이브리드 추론 모델로, 비용과 성능, 지연 시간의 균형을 맞추는 데 최적화되어 있으며, 토큰 소비를 20~30% 줄이는 등 효율성도 크게 개선되었습니다

- Gemini는 이제 텍스트뿐 아니라 오디오, 이미지 등 멀티모달 입력을 지원하며, 네이티브 오디오 출력을 통해 자연스러운 대화형 AI 경험을 제공합니다

- 사실감, 표현력이 버전을 거듭되면서 놀라운 결과를 제공하는 Veo3, Imagen4가 공개되었습니다.

2. AI 모드 검색과 구글 서비스 통합

- 구글 검색에 ‘AI 모드’가 도입되어, 복잡하고 긴 쿼리도 쉽게 처리할 수 있게 되었습니다. ‘질의 팬-아웃(query fan-out)’ 기법을 활용해, 사용자의 질문을 여러 하위 검색으로 분해한 뒤, 실시간으로 다양한 웹사이트의 정보를 분석·통합해 결과를 제공합니다.

- 그외에도 검색 라이브(Search Live), 쇼핑 제품 탐색 기능, 개인화 경험을 위해 과거 검색 기록을 기반으로 맞춤 추천 등을 지원합니다.

- 이 기능은 미국 내에서 우선 적용되며, 향후 글로벌 확대가 예상됩니다. 구글은 Gemini와 검색의 긴밀한 통합을 통해 정보 탐색의 패러다임을 바꾸겠다는 비전을 제시했습니다.

3. 차세대 AI 비서와 XR(확장현실)

- Gemini 기반의 개인화된 AI 비서가 등장했습니다. 이 비서는 사용자의 맥락을 이해하고, 여러 기기와 연동해 일상적인 작업부터 복잡한 요청까지 처리할 수 있습니다. 내가 자주 사용하는 말투, 기록들을 기반으로 이메일에 답장을 할 수 있는 기능까지도 제공할 예정이라고 합니다.

- 구글은 안드로이드 XR 스마트글라스도 공개했습니다. 이 기기들은 AI 비서와 증강현실 기능을 결합해, 현실에서 새로운 경험을 제공합니다.

- 스마트글라스는 Gentle Monster, Warby Parker와의 협업으로 더욱 세련된 디자인을 선보이며, 내년부터 개발자들이 직접 앱을 개발할 수 있도록 지원할 예정입니다

4. 개발자 및 클라우드 생태계 지원

- Gemini Code Assitant For Github (Gemini 2.5 기반)를 선보였습니다. 버그 추적, 코드변환, 신규 구성원을 위한 온보딩 가이드 생성 등 대규모 복잡한 작업에 유요합니다.

- 구글은 AI 기반 코드 도우미 ‘Jules’의 공개 베타를 시작했으며, 개발자를 위한 오디오 합성, 멀티모달 API 등 다양한 도구를 선보였습니다.

- 구글 클라우드용 차세대 AI 칩 ‘Ironwood’도 발표되어, 엔터프라이즈 시장에서의 AI 활용이 한층 확대될 전망입니다.

향후 전망

- AI 일상화와 초개인화: Gemini 2.5와 AI 모드 검색의 도입은 AI가 단순 정보 제공을 넘어, 상황에 맞는 맞춤형 조언과 실행까지 담당하는 ‘초개인화’ 시대를 앞당길 것으로 보입니다. 구글은 Gemini를 ‘범용 AI 어시스턴트’로 진화시키겠다는 청사진을 제시했습니다

- 멀티모달·실시간 AI 서비스 확장: 오디오, 비디오, 이미지 등 다양한 입력을 실시간으로 처리하는 멀티모달 AI가 본격적으로 일상에 녹아들 전망입니다. 사실감과 표현력이 거듭된 버전을 통해 상상을 뛰어넘고 있습니다. AI 기반 영상 생성(Veo 3), 이미지 생성(Imagen 4) 등도 서비스로 확장될 예정입니다

- XR·스마트기기 생태계 성장: XR 헤드셋과 스마트글라스 등 차세대 기기와 AI의 결합은 새로운 사용자 경험을 창출할 것입니다. 구글의 XR 플랫폼 개방은 개발자와 파트너사 생태계 확장으로 이어질 것으로 기대됩니다

- AI 서비스의 대중화와 경쟁 심화: 구글은 Gemini Ultra 등 구독형 AI 서비스도 발표하며, AI 경쟁이 본격화될 것으로 보입니다. AI의 성능, 효율성, 가격경쟁력이 시장의 핵심 변수가 될 전망입니다

결론

구글 I/O 2025는 AI가 구글의 모든 서비스와 생태계의 중심에 자리잡았음을 선언한 행사였습니다. Gemini 2.5와 AI 모드 검색, 차세대 XR 기기 등은 앞으로의 기술 트렌드를 가늠할 수 있는 지표가 되었으며, AI의 일상화와 초개인화, 그리고 새로운 디지털 경험이 본격적으로 펼쳐질 것으로 기대됩니다.

구글 I/O의 모든 세션과 발표 내용은 온디맨드로 제공되며, 전 세계 개발자들은 LinkedIn과 Instagram을 통해 I/O Connect 이벤트에 참여할 수 있습니다.

세션 발표 볼수 있는 링크 : https://io.google/2025/explore

본 포스트는 행사에서 관심이 있을 주요 내용들을 정리하여 블로그 포스트 하였으며, 자세한 내용은 https://blog.google/technology/ai/io-2025-keynote/ 으로 부터 더 다양한 정보를 얻을 수 있습니다.

답글 남기기